La compañía comenzó a probar GPT-5.4-Cyber, un sistema enfocado en detectar vulnerabilidades en software, mientras crecen las preocupaciones por el uso malicioso de estas tecnologías.

***

- OpenAI prueba modelo GPT-5.4-Cyber para detectar fallas en software.

- El acceso inicial será limitado a expertos en ciberseguridad.

- Surgen temores por uso indebido de IA en ataques informáticos.

🚨 OpenAI lanza GPT-5.4-Cyber, un modelo de IA especializado en detectar vulnerabilidades en software.

El acceso inicial es limitado a expertos en ciberseguridad.

Esta herramienta surge en medio de crecientes preocupaciones sobre el uso malicioso de la IA.

La competencia con… pic.twitter.com/H6XIsuVbO2

— Diario฿itcoin (@DiarioBitcoin) April 15, 2026

OpenAI ha comenzado a desplegar GPT-5.4-Cyber, un nuevo modelo de inteligencia artificial diseñado específicamente para detectar vulnerabilidades en software. La herramienta busca ayudar a organizaciones a identificar fallas de seguridad antes de que puedan ser explotadas, en un contexto donde el análisis automatizado de código se vuelve cada vez más crítico para la protección digital.

El lanzamiento ocurre apenas una semana después de que Anthropic presentara su modelo Mythos, lo que evidencia una competencia acelerada entre ambas compañías por liderar el desarrollo de soluciones avanzadas en ciberseguridad. Esta coincidencia temporal refuerza la idea de que la seguridad informática se está consolidando como uno de los campos clave en la evolución de la inteligencia artificial aplicada, indica Bloomberg.

Acceso restringido y despliegue progresivo

En esta primera etapa, OpenAI ha decidido limitar el acceso a GPT-5.4-Cyber a un grupo reducido de usuarios dentro de su programa Trusted Access for Cyber, lanzado en febrero. Este programa permite a clientes seleccionados y profesionales especializados probar las capacidades más avanzadas de la compañía en entornos controlados.

Inicialmente, el modelo estará disponible para cientos de usuarios, aunque OpenAI prevé ampliar el acceso a miles en las próximas semanas. Este despliegue gradual responde a la necesidad de monitorear de cerca el comportamiento del sistema, considerando tanto su utilidad como los posibles riesgos asociados a su uso.

Un elemento relevante del modelo es que introduce menos restricciones en la forma en que los usuarios pueden interactuar con él para analizar vulnerabilidades. Esta mayor flexibilidad podría mejorar la capacidad de detección, pero también aumenta la sensibilidad del sistema frente a posibles usos indebidos.

Una carrera tecnológica con riesgos crecientes

El desarrollo de modelos como GPT-5.4-Cyber y Mythos refleja una tendencia clara en la industria: la integración de capacidades avanzadas de programación y análisis de seguridad dentro de sistemas de inteligencia artificial.

A medida que estos modelos mejoran, su valor para empresas aumenta, especialmente en tareas como auditoría de código, detección de errores y fortalecimiento de sistemas. Sin embargo, este mismo progreso ha generado preocupación entre expertos y autoridades.

La razón es que las herramientas capaces de identificar vulnerabilidades también pueden ser utilizadas para explotarlas. De hecho, ya existen señales de que tecnologías basadas en IA están siendo empleadas para facilitar ciberataques, lo que introduce un nuevo nivel de complejidad en el panorama de seguridad digital.

Este doble uso convierte a estos modelos en herramientas de alto impacto, cuya gestión requiere controles estrictos y acceso cuidadosamente regulado.

Mythos y las alertas en el sector financiero

El caso del modelo Mythos de Anthropic ilustra claramente estas tensiones. Diseñado para identificar y explotar vulnerabilidades en sistemas operativos y navegadores, el modelo fue distribuido únicamente a un grupo selecto de socios de confianza.

Entre estos se encuentran empresas como Amazon, Apple y Microsoft, que lo utilizan para reforzar la seguridad de sus plataformas. A pesar de este enfoque restringido, el lanzamiento generó inquietud en sectores críticos.

Según reportó Bloomberg, durante una reunión con líderes de Wall Street convocada por el secretario del Tesoro de Estados Unidos, Scott Bessent, y el presidente de la Reserva Federal, Jerome Powell, se advirtió a los ejecutivos sobre la necesidad de tomar en serio las capacidades de este tipo de modelos.

Estas advertencias reflejan la creciente preocupación por el impacto que la inteligencia artificial podría tener en la estabilidad de sistemas financieros y en la seguridad de infraestructuras críticas.

Interés gubernamental y futuro de la ciberseguridad con IA

El interés por estas herramientas también se extiende al ámbito gubernamental. El equipo tecnológico del Departamento del Tesoro de Estados Unidos ha comenzado a buscar acceso a Mythos con el objetivo de identificar vulnerabilidades en sistemas sensibles.

Este movimiento sugiere que los gobiernos están adoptando una postura activa frente a los riesgos emergentes, intentando aprovechar las capacidades de la inteligencia artificial para fortalecer sus defensas.

Sin embargo, la situación plantea desafíos importantes. La línea entre uso defensivo y ofensivo se vuelve cada vez más difusa, lo que obliga a establecer marcos de control más estrictos y mecanismos de supervisión adecuados.

En este contexto, el desarrollo de GPT-5.4-Cyber por parte de OpenAI no solo representa un avance tecnológico, sino también un punto de inflexión en el debate sobre cómo gestionar herramientas de inteligencia artificial con alto potencial de impacto en la seguridad global.

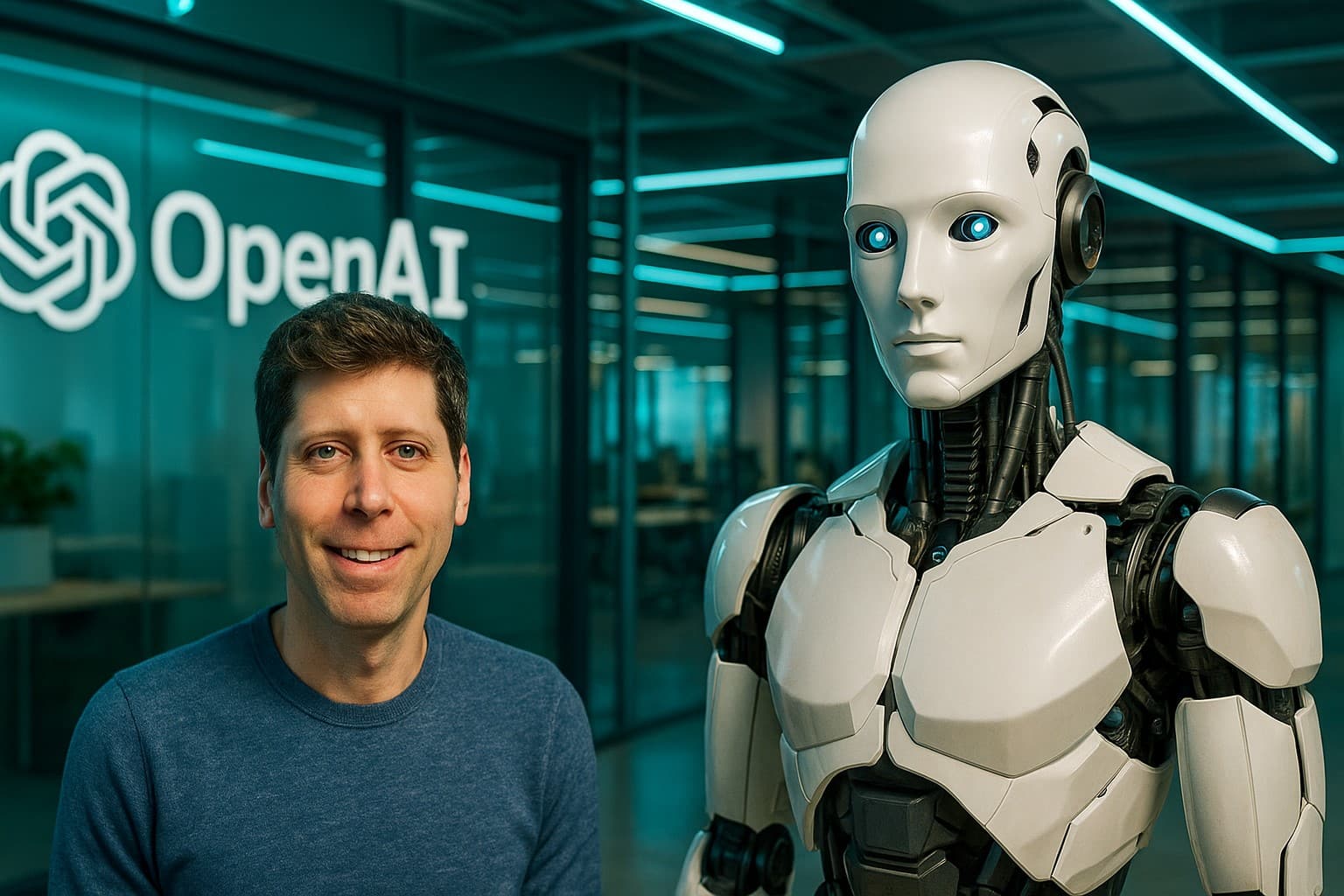

Imagen original de DiarioBitcoin, creada con inteligencia artificial, de uso libre, licenciada bajo Dominio Público.

Este artículo fue escrito por un redactor de contenido de IA y revisado por un editor humano para garantizar calidad y precisión.

ADVERTENCIA: DiarioBitcoin ofrece contenido informativo y educativo sobre diversos temas, incluyendo criptomonedas, IA, tecnología y regulaciones. No brindamos asesoramiento financiero. Las inversiones en criptoactivos son de alto riesgo y pueden no ser adecuadas para todos. Investigue, consulte a un experto y verifique la legislación aplicable antes de invertir. Podría perder todo su capital.

Suscríbete a nuestro boletín

Artículos Relacionados

Blockchain

Blockchain

Investigadores consideran que Blockchain no necesariamente resuelve problemas presentes en la IA

Educación

Educación

Meta lanza academia laboral en Baton Rouge para formar técnicos en plena era de la IA

Empresas

Empresas

Waymo compra por USD $220 millones antiguo campo de pruebas autónomas de Apple en Arizona

Estados Unidos

Estados Unidos